[笔记系列文章说明]: 该类型的文章是笔者学习过程中整理的学习笔记.

Vue 是一种JS,HTML,CSS渲染框架,通过其独特的绑定渲染方式,使页面编程更加方便,容易(JS语法糖).

生态圈

- Vue Router

- Vuex

- Vue Loader

- Vue Test Utils

- Vue Dev-Tools

- Vue CLI

- Vetur

[笔记系列文章说明]: 该类型的文章是笔者学习过程中整理的学习笔记.

Vue 是一种JS,HTML,CSS渲染框架,通过其独特的绑定渲染方式,使页面编程更加方便,容易(JS语法糖).

生态圈

[笔记系列文章说明]: 该类型的文章是笔者学习过程中整理的学习笔记.

ECMAScript6 是JS的版本升级,主流浏览器和手机固件都已支持解析. 对过去来说的JS其实也是ECMAcript, 不过是老版本,名字也没有变. 6版本对JS的编写规则进行了封装, 形成了一套新的编写方式. 对于不支持解析的容器上,

可以通过EC6转EC5工具进行转换后运行(如Babel)

ECMAScript 和 JavaScript 的关系 ECMAScript是发布国际标准的组织,JavaScript是Netscape创建的,后提交给ECMAScript ECMAScript= 标准 JavaScript= 实现(

3.0)

ECMAScript的版本 从3.0到 3.1=5 到6 中间版本没有通过…

1 | { |

1, 适用于局部使用的变量: for循环, 临时变量 2, let非顺序执行将报错,var将显示undefined(var的变量提升未执行先使用将导致undefined)

3, let在区块中后者覆盖前者,前者将报错失效(单位内唯一性)

4, var中作用域为全局和方法中, ECMA6增加区块作用域,使用let实现

1 | const DEFAULT_VALUE = 3; |

1, 声明后必须赋值 2, 再赋值将报错 3, 支持区块作用域 4, 地址级别的常量,类似JAVA中的对象常量

[笔记系列文章说明]: 该类型的文章是笔者学习过程中整理的学习笔记.

Markdown 是一种轻量级标记语言,它允许人们使用易读易写的纯文本格式编写文档.(文档格式语言)

1 | 一级标题 |

1 | # 一 |

[笔记系列文章说明]: 该类型的文章是笔者学习过程中整理的学习笔记.

与不绝对信任的机构或企业交换数据的时候, 通常需要考虑严格的数据安全问题, 我在这里定义了一种, 完整版就不放了, 列一些关键的点

请求方式: http请求post方式

请求类型: application/json;charset=utf-8

返回类型: application/json;charset=utf-8

域名:

| 参数 | 类型 | 说明 | 例 |

|---|---|---|---|

| plantformCode | String | 商家授权码 | 如: |

| timeStamp | Long | 时间戳 | 如:1626255054672 (相当于2021-07-14 17:30:54) |

| sign | String | 签名 | 8d2472fac5a4a1879bde18075f7a879e |

| 参数 | 类型 | 说明 | 例 |

|---|---|---|---|

| messageId | String | 消息唯一标识 | |

| data | String | JSON字符串 | |

| timeStamp | Long | 时间戳 | |

| dataSource | String | 数据来源,供应商唯一标识 | 如BOLIAN |

[笔记系列文章说明]: 该类型的文章是笔者学习过程中整理的学习笔记.

本篇整理一下项目中用到的管理代码的规范

分支环境:

开发环境:dev

测试环境:test

预生产环境:prev

生产环境:master

根据需要会分出test_2.0、test_bug等次级分支,测试到上线都会在这个分支进行。最终会同步到test、master分支。

分支代码从prev拉取

分支命名规则: 项目名++日期++类型++开发名称/bug号/bug名称(++修复人标识)

需求开发分支命名:

1 | stc_20210629_dev_version2 |

[笔记系列文章说明]: 该类型的文章是笔者学习过程中整理的学习笔记.

1 | IDE: idea |

1 | 代码管理: git, gitlab |

1 | 远程调用体系: |

[笔记系列文章说明]: 该类型的文章是笔者学习过程中整理的学习笔记.

1 |

|

什么是MDC?

Mapped Diagnostic Context

线程独立自定义Map存储上下文信息,子线程拷贝父线程Map信息

1 | 1.保存信息到上下文 |

什么是NDC?

Nested Diagnostic Context

线程独立自定义栈存储上下文信息,子线程拷贝父线程栈信息

1 | 1.开始调用 |

1 |

|

1 | /** |

1 | public class TraceConsumerFilter implements Filter { |

消费者获取值

1 | public class TraceProviderFilter implements Filter { |

调用者配置 spring-dubbo-reference.xml

1 | <dubbo:consumer filter="traceConsumerFilter" version="1.0" timeout="3000" check="${dubbo.reference.check}"/> |

提供者者配置 spring-dubbo-provider.xml

1 | <dubbo:provider protocol="dubbo" filter="traceProviderFilter" version="1.0" timeout="3500" delay="-1" /> |

增加dubbo filter配置

1 | 路径: src/main/resources/META-INF/dubbo/com.alibaba.dubbo.rpc.Filter |

[笔记系列文章说明]: 该类型的文章是笔者学习过程中整理的学习笔记.

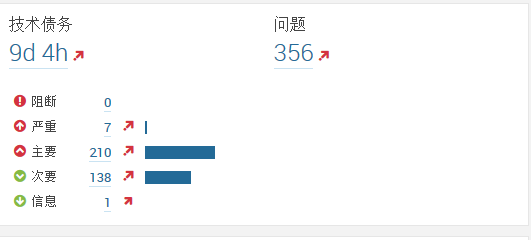

技术债务:没有按照规范所编写设计的代码(走捷径),或者错误代码.

这些产生的问题,需要在以后的工作中需要被修复所花的时间(即称为债务).

测试地址:192.168.10.221:9000 用户名:admin 密码:admin 数据库:192.168.10.222 scholar2test/scholar2test

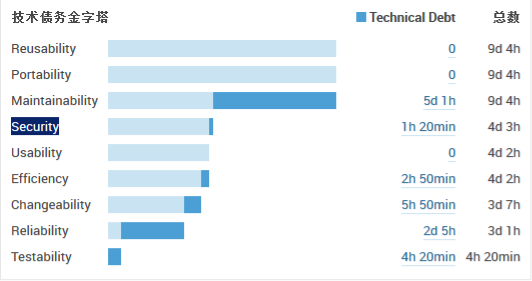

#####根据债务的不同特性分为8种:

下图对应:

可重用性

可移植性

可维护性

安全性

实用性

效率

可变性(低耦合?)

可靠性

可测性

1:Bug和潜在的Bug

2,违反编码标准

3,重复

4,单元测试信息

5,复杂的代码

6,结构设计

7,注释

产生债务原因已经找到,通过人力去分析代码,进行优化改进比较麻烦。通过工具,按照我们使用者的意愿去分析代码并且呈现出来,这些就是sonar所要做的事情。

前提:想要对项目进行严格的分析,修改,把控,需要项目具有良好的编码规范。没有这方面需求,使用sonar没有意义。

以下介绍七种产生债务原因在图形化界面上的查看与分析方式

以下会穿插部分界面的解释,以默认规则,默认插件为例。

根据字面意思可以理解

这种原因通常问题严重性标记为:Blocker(阻断)

通过下图观察:

[笔记系列文章说明]: 该类型的文章是笔者学习过程中整理的学习笔记.

根据规则分析源代码,进行数据统计,呈现在可视化界面,方便使用者对代码分析。

使用软件:

Sonar-runner客户端:配置sonar服务端配置之后,可与sonar服务端结合分析,存储项目

maven或者Jenkins集成sonar,底层利用Sonar-runner客户端工具。

1, 配置

1 | 配置sonarqube配置文件\conf\sonar.properties |

2, 版权问题使用oracle时自己导jdbc包

extensions/jdbc-driver/oracle目录下放入对应的oracle驱动jar包

路径oracle客户端目录 client_1\jdbc\lib下

3, 导入汉化包extensions/plugins

下载地址:http://docs.codehaus.org/display/SONAR/Chinese+Pack

4, 找到对应系统的执行目录,这里运行/bin/linux-x86-64/sonar.sh

[笔记系列文章说明]: 该类型的文章是笔者学习过程中整理的学习笔记.

JDK Version 1.0

开发代号为Oak(橡树),于1996-01-23发行.

JDK Version 1.1

于1997-02-19发行.

引入的新特性包括:

引入JDBC(Java DataBase Connectivity);

支持内部类;

引入Java Bean;

引入RMI(Remote Method Invocation)

引入反射(仅用于内省)

J2SE Version 1.2